Kaj je linearna regresija v R?

Linearna regresija je najbolj priljubljen in pogosto uporabljen algoritem na področju statistike in strojnega učenja. Linearna regresija je tehnika modeliranja za razumevanje razmerja med vhodnimi in izhodnimi spremenljivkami. Tu morajo biti spremenljivke numerične. Linearna regresija izhaja iz dejstva, da je izhodna spremenljivka linearna kombinacija vhodnih spremenljivk. Izhod je običajno predstavljen z „y“, medtem ko je vhod predstavljen z „x“.

Linearno regresijo v R lahko razvrstimo na dva načina

-

Si mple Linearna regresija

To je regresija, kjer je izhodna spremenljivka funkcija ene vhodne spremenljivke. Prikaz preproste linearne regresije:

y = c0 + c1 * x1

-

Večplastna regresija

To je regresija, kjer je izhodna spremenljivka funkcija spremenljivke z več vhodi.

y = c0 + c1 * x1 + c2 * x2

V obeh zgornjih primerih so c0, c1, c2 koeficient, ki predstavlja regresijske uteži.

Linearna regresija v R

R je zelo močno statistično orodje. Pa si poglejmo, kako se lahko v R izvede linearna regresija in kako je mogoče razlagati njene izhodne vrednosti.

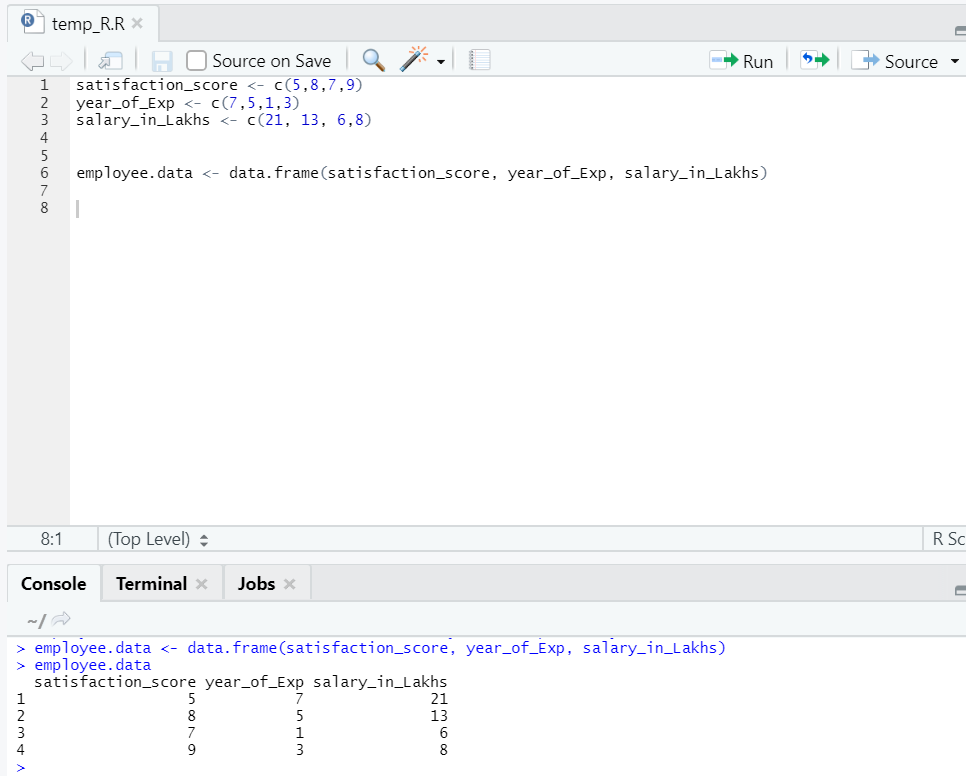

Pripravimo nabor podatkov, da bomo zdaj poglobljeno izvedli in razumeli linearno regresijo.

Zdaj imamo nabor podatkov, v katerih sta "zadovoljstvo_score" in "year_of_Exp" neodvisni spremenljivki. „Plača_in_lakhs“ je izhodna spremenljivka.

Glede na zgornji nabor podatkov je problem, ki ga želimo tukaj rešiti z linearno regresijo:

Ocena plače zaposlenega na podlagi letnih izkušenj in ocene zadovoljstva v njegovem podjetju.

R koda linearne regresije:

model <- lm(salary_in_Lakhs ~ satisfaction_score + year_of_Exp, data = employee.data)

summary(model)

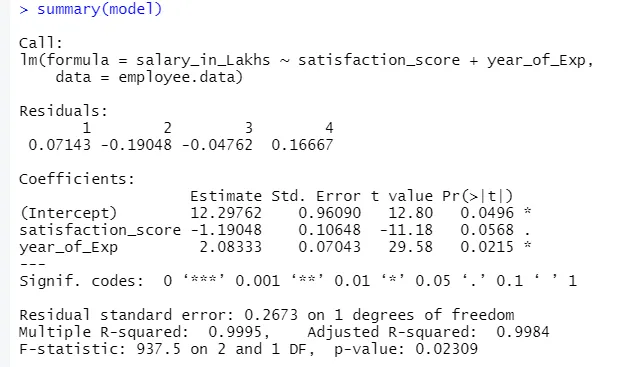

Izhod zgornje kode bo:

Formula regresije postane

Y = 12, 29-1, 19 * zadovoljstvo_sledje + 2, 08 × 2 * leto_iz_Exp

V primeru, da ima eden več vhodov v model.

Potem je lahko R koda:

model <- lm (plača_in_Lakhs ~., podatki = zaposleni.podatki)

Če pa želi nekdo izbrati spremenljivko iz več vhodnih spremenljivk, je na voljo več tehnik, kot so "nazaj odstranjevanje", "naprej izbira" itd.

Interpretacija linearne regresije v R

Spodaj je nekaj interpretacij linearne regresije v r, ki so naslednje:

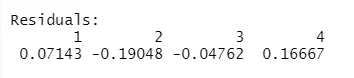

1.Ostanki

To se nanaša na razliko med dejanskim odzivom in predvidenim odzivom modela. Tako bo za vsako točko en dejanski odziv in en predviden odziv. Zato bo ostankov toliko, kolikor jih je opazovanj. V našem primeru imamo štiri opažanja, torej štiri ostanke.

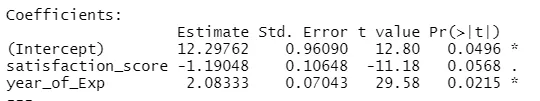

2.Koeficijenti

Če gremo dalje, bomo našli odsek s koeficienti, ki prikazuje prestrezanje in naklon. Če želite napovedati plačo zaposlenega na podlagi njegovih izkušenj in zadovoljstva, je treba razviti vzorčno formulo, ki temelji na naklonu in prestrezanju. Ta formula vam bo pomagala pri napovedovanju plače. Prestrezanje in nagib pomagajo analitiku, da si ustvari najboljši model, ki primerno ustreza podatkom.

Naklon: Prikaz strmine črte.

Prestrezanje: lokacija, kjer črta preseka os.

Razumejmo, kako se oblikuje formula na podlagi naklona in prestrezanja.

Recimo, da je prestrezanje 3, naklon pa 5.

Torej, formula je y = 3 + 5x . To pomeni, če se x poveča za enoto, y se poveča za 5.

a.koeficient - ocena

Pri tem prestreznik označuje povprečno vrednost izhodne spremenljivke, ko ves vhod postane nič. Torej bo v našem primeru plača v lahkih 12, 29 lahk kot povprečna glede na oceno zadovoljstva in izkušenj znaša nič. Tu nagib predstavlja spremembo izhodne spremenljivke z enotno spremembo vhodne spremenljivke.

b.koeficient - standardna napaka

Standardna napaka je ocena napake, ki jo lahko dobimo pri izračunu razlike med dejansko in predvideno vrednostjo naše spremenljivke odziva. Po drugi strani to govori o zaupnosti za povezavo vhodnih in izhodnih spremenljivk.

c.koeficient - vrednost t

Ta vrednost daje zaupanje, da zavrne ničelno hipotezo. Večja kot je vrednost od nič, večja je zaupanje v zavrnitev ničelne hipoteze in vzpostavitev razmerja med izhodno in vhodno spremenljivko. Tudi v našem primeru vrednost ni nič.

d.koef. - Pr (> t)

Ta akronim v bistvu prikazuje vrednost p. Bolj kot je nič, lažje lahko zavrnemo nično hipotezo. V vrstici, ki jo vidimo v našem primeru, je ta vrednost blizu nič, lahko rečemo, da obstaja razmerje med plačnim paketom, oceno zadovoljstva in letom izkušenj.

Preostala standardna napaka

To prikazuje napako pri napovedovanju spremenljivke odziva. Nižja kot je, večja je natančnost modela.

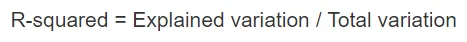

Več R-kvadratov, Prilagojeni R-kvadrat

R-kvadrat je zelo pomemben statistični ukrep za razumevanje, kako blizu so se podatki vklopili v model. Torej v našem primeru, kako dobro naš model z linearno regresijo predstavlja nabor podatkov.

Vrednost R-kvadrata je vedno med 0 in 1. Formula je:

Bolj ko je vrednost enaka 1, boljši model opisuje nabore podatkov in njihovo variacijo.

Ko pa na sliko pride več kot ena vhodna spremenljivka, je prednostna nastavljena vrednost R kvadrata.

F-statistika

To je močno merilo za določitev razmerja med spremenljivko vnosa in odziva. Večja kot je vrednost 1, večja je zaupanje v razmerje med vhodno in izhodno spremenljivko.

V našem primeru je to "937, 5", kar je glede na velikost podatkov relativno večje. Zato postane zavračanje nične hipoteze lažje.

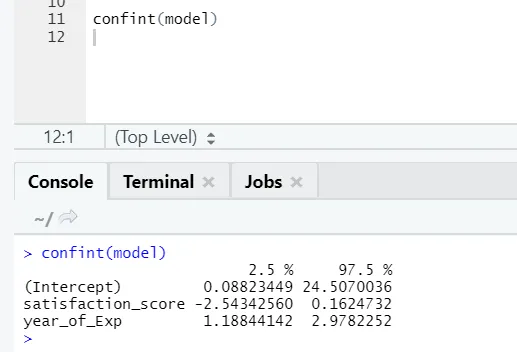

Če želi kdo videti interval zaupanja za koeficiente modela, je to način:

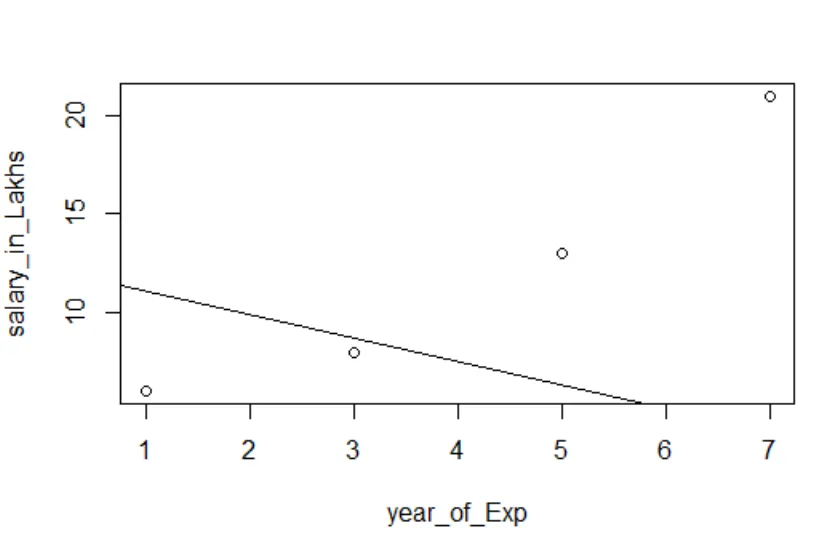

Vizualizacija regresije

R koda:

parcela (plača_in_Lakh ~ zadovoljstvo_score + leto_of_Exp, podatki = zaposleni.podatki)

abline (model)

Vedno je bolje zbrati več in več točk, preden se prilega modelu.

Zaključek - Linearna regresija v R

Linearna regresija je enostavna, enostavna za namestitev, lahko razumljiva, a zelo zmogljiv model. Videli smo, kako lahko izvajamo linearno regresijo na R. Poizkusili smo tudi interpretacijo rezultatov, kar vam lahko pomaga pri optimizaciji modela. Ko se nekomu privoščite preprosti linearni regresiji, morate poskusiti z več linearno regresijo. Poleg tega je linearna regresija občutljiva za odbitke, zato je treba pogledati vanjo, preden neposredno skočimo v prileganje na linearno regresijo.

Priporočeni članki

To je vodnik za Linearno regresijo v R. Tu smo razpravljali, kaj je linearna regresija v R? kategorizacija, vizualizacija in interpretacija R. Če želite izvedeti več, lahko preberete tudi druge naše predlagane članke -

- Predvidevno modeliranje

- Logistična regresija v R

- Drevo odločitve v R

- R Intervju Vprašanja

- Najpomembnejše razlike med regresijo in klasifikacijo

- Vodnik po drevesu odločitev v strojnem učenju

- Linearna regresija proti logistični regresiji | Najboljše razlike