Uvod v jedrske metode v strojnem učenju

Algoritem, uporabljen za analizo vzorcev, v strojnem učenju imenujemo Kernel metoda. Na splošno je analiza narejena za iskanje razmerij v naboru podatkov. Ti odnosi so lahko gručenje, razvrščanje, glavne komponente, korelacija itd. Večino teh algoritmov, ki rešujejo te naloge analize vzorca, potrebujejo podatke v surovem reprezentativcu, je treba izrecno spremeniti v predstavitev vektorja lastnosti. To transformacijo je mogoče izvesti z uporabniško določenim zemljevidom funkcij. Torej lahko vzamemo, da metoda jedra zahteva samo jedro, ki ga določa uporabnik.

Terminološka metoda Kernal izhaja iz dejstva, da uporabljajo funkcijo jedra, ki jim omogoča izvajanje operacije v velikem, implicitnem imigracijskem prostoru, ne da bi bilo treba izračunati koordinate podatkov v tem prostoru. Namesto tega preprosto izračunajo notranji izdelek med slikami vseh parov podatkov v funkcijskem prostoru.

Tovrstne operacije so večino časa računsko cenejše v primerjavi z izrecnim računanjem koordinat. To tehniko imenujemo "jederni trik". Vsak linearni model lahko pretvorimo v nelinearen model z uporabo trika v jedru.

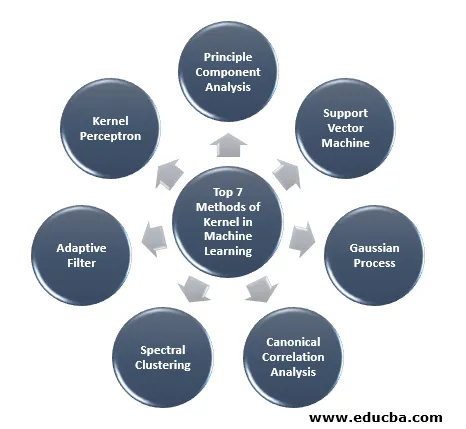

Metoda jedra, ki je na voljo pri strojnem učenju, je analiza glavnih komponent (PCA), spektralno združevanje, podporni vektorski stroji (SVM), kanonična korelacijska analiza, perceptron jedra, Gausovi procesi, regresija grebena, linearni prilagodljivi filtri in mnogi drugi. Imejmo na visoki ravni razumevanje nekaterih teh metod jedra.

Najboljših 7 metod jedrca v strojnem učenju

Spodaj so omenjene metode jedra v strojnem učenju:

1. Analiza osnovnih komponent

Analiza glavnih komponent (PCA) je tehnika za pridobivanje strukture iz morda velikih dimenzijskih nizov podatkov. To se zlahka izvede z uporabo iterativnih algoritmov, ki ocenjujejo glavne sestavne dele ali z reševanjem problema lastne vrednosti. PCA je pravokotna transformacija koordinatnega sistema, v katerem opisujemo svoje podatke. Nov koordinatni sistem dobimo s projekcijo na glavne osi podatkov. Majhno število glavnih komponent pogosto zadostuje za večino strukture v podatkih. Ena izmed njegovih pomembnejših aplikacij je izvajanje raziskovalnih podatkovnih podatkov za izdelavo napovednega modela. Večinoma se je uporabljal za prikaz vizualne povezanosti med populacijami in genetsko distanco.

2. Podporni vektorski stroj

SVM je mogoče opredeliti kot klasifikator za ločevanje hiperplanov, kjer je hiperplaner podprostor ene dimenzije, ki je manjši od prostora. Dimenzija tega matematičnega prostora je opredeljena kot najmanjše število koordinat, potrebnih za določitev katere koli točke, medtem ko je zunanji prostor prostor, ki obdaja matematični objekt. Zdaj je matematični objekt mogoče razumeti kot abstraktni objekt, ki ne obstaja kadarkoli ali na mestu, ampak obstaja kot vrsta stvari.

3. Gaussov proces

Gaussov proces je dobil ime po Cark Friedrich Gauss, ker uporablja oznako Gaussove distribucije (normalna porazdelitev). To je stohastični postopek, ki pomeni zbirko naključnih spremenljivk, indeksiranih s časom ali prostorom. V Gaussovem procesu imajo naključne spremenljivke večvariatno normalno porazdelitev, tj. Vse končne linearne kombinacije so normalno porazdeljene. Gaussov postopek uporablja lastnosti, podedovane iz običajne porazdelitve, in so zato uporabne pri statističnem modeliranju. Algoritem strojnega učenja, ki vključuje to metodo jedra, uporablja merilo lenega učenja in podobnosti med točkami, da napove vrednost nevidnih točk iz podatkov o vadbi. To napoved ni samo ocena, ampak negotovost v tistem trenutku.

4. Kanonična korelacijska analiza

Kanonična korelacijska analiza je način sklepanja informacij iz navzkrižnih kovariance matric. Znana je tudi kot analiza kanonskih spremenljivk. Recimo, da imamo dva vektorja X, Y naključne spremenljivke, recimo dva vektorja X = (X1, …, Xn) in vektor Y = (Y1, …, Ym), in spremenljivko, ki ima korelacijo, bo CCA izračunala linearno kombinacijo X in Y, ki ima med seboj največjo korelacijo.

5. Spektralna gruča

Pri uporabi segmentacije slike je spektralno združevanje znano kot kategorizacija predmetov, ki temelji na segmentaciji. V spektralnem grozdu se zmanjšanje dimenzij izvede pred združevanjem v manj dimenzije, to se izvede z uporabo lastne vrednosti matrice podobnosti podatkov. Svoje korenine ima v teoriji grafov, kjer se ta pristop uporablja za identifikacijo skupnosti vozlišč v grafu, ki temelji na robovih, ki jih povezujejo. Ta metoda je dovolj fleksibilna in nam omogoča tudi združevanje podatkov iz drugih grafov.

6. Prilagodljivi filter

Prilagodljivi filter uporablja linearni filter, ki vsebuje funkcijo prenosa, ki jo nadzirajo spremenljivi parametri in metode, ki bodo uporabljene za prilagoditev teh parametrov glede na algoritem optimizacije. Zapletenost tega algoritma za optimizacijo je razlog, da je ves prilagodljivi filter digitalni filter. Prilagodljivi filter je potreben v tistih aplikacijah, kjer predhodno ni podatkov o želenem postopku obdelave ali pa se ti spreminjajo.

Funkcija stroškov se uporablja v adaptivnem filtru v zaprti zanki, saj je potrebna za optimalno delovanje filtra. Določa, kako spremeniti funkcijo prenosa filtra, da zmanjša stroške naslednje ponovitve. Ena najpogostejših funkcij je povprečna kvadratna napaka signala napake.

7. Jedro Perceptron

Pri strojnem učenju je perceptron jedra vrsta priljubljenega algoritma učenja perceptrona, ki se lahko nauči strojev jeder, na primer nelinearnih klasifikatorjev, ki uporabljajo funkcijo jedra za izračun podobnosti tistih vzorcev, ki niso vidni vzorcem za usposabljanje. Ta algoritem je bil izumljen leta 1964, s čimer je postal prvi učitelj klasifikacije jeder.

Večina obravnavanih algoritmov jedra temelji na konveksni optimizaciji ali lastnih težavah in je statistično utemeljena. Njihove statistične lastnosti se analizirajo s pomočjo teorije statističnega učenja.

Ko govorimo o področjih uporabe metod jedrcev, je to raznoliko in vključuje geostatistiko, kriging, tehtanje obratne razdalje, 3D rekonstrukcijo, bioinformatiko, kemoinformatiko, pridobivanje informacij in prepoznavanje rokopisa.

Zaključek

Povzela sem nekaj terminologij in vrst jedrskih metod v strojnem učenju. Zaradi pomanjkanja prostora ta članek nikakor ni izčrpen in je namenjen le razumevanju, kaj je metoda jedra, in kratek povzetek njihovih vrst. Vendar boste s tem člankom naredili prvi korak na področju strojnega učenja.

Priporočeni članki

To je vodnik za metodo Kernel v strojnem učenju. Tukaj razpravljamo o 7 vrstah jedrskih metod v strojnem učenju. Lahko pogledate tudi naslednji članek.

- Monolitno jedro

- Grozd v strojnem učenju

- Strojno učenje podatkovne znanosti

- Nenadzorovano strojno učenje

- PHP filtri | Kako preveriti uporabniški vnos z različnimi filtri?

- Celoten vodnik o življenjskem ciklu strojnega učenja