Kaj je Bayesov teorem?

Bayesov izrek je recept, ki prikazuje, kako ob dokazu osvežiti verjetnosti teorij. V bistvu izhaja iz maksim pogojne verjetnosti, vendar ga je mogoče uporabiti za utemeljevanje širokega obsega vprašanj, vključno z osvežitvijo obsodbe.

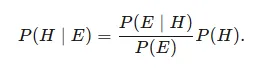

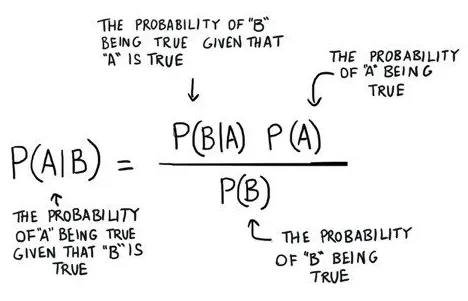

Glede na teorijo H in dokaz E, Bayesov teorem izraža, da je povezava med verjetnostjo špekuliranja pred pridobitvijo dokaza P (H) in verjetnostjo teorije ob pridobitvi dokaza P (H∣E)

To je lep koncept Verjetnost, kjer najdemo verjetnost, ko poznamo drugo verjetnost

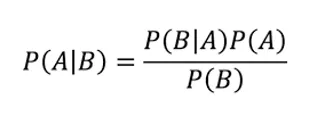

Kar nam pove: kako se redno zgodi A glede na to, da se pojavi B, sestavljen iz P (A | B),

Ko vemo: kako se redno zgodi B glede na to, da se pojavi An, sestavljen P (B | A)

poleg tega, kako verjetno je An brez nikogar drugega, sestavljen P (A)

še več, kako verjetno je B brez koga drugega, sestavljen P (B)

Primer teorema Bayesa

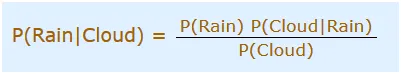

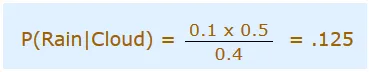

Danes si uredite izlet, vendar je jutro oblačno, Bog nam pomaga! polovica vsakega nevihtnega dne se začne v senci! Vsekakor so senčna jutra običajna (približno 40% dni se začne oblačno) Poleg tega je to na splošno suh mesec (samo 3 od 30 dni bo na splošno nevihtno ali 10%). Kakšna je verjetnost naliva čez dan? Dež bomo izkoristili za pljusk čez dan, oblak pa za oblačno jutro. Možnost dežja z oblakom je sestavljena iz P (dež | oblak)

Torej bi morali to postaviti v enačbo:

- P (dež) verjetnost, da bo dež = 10% (dano)

- P (oblak | dež) verjetnost, da so tam oblaki in se zgodi dež = 50%

- P (oblak) je verjetnost, da so tam oblaki = 40%

Torej lahko rečemo, da v c:

To je Bayesov teorem: da lahko izkoristite verjetnost ene stvari, da predvidite verjetnost nečesa drugega. Pa vendar, Bayesov teorem je vse prej kot statična stvar. To je stroj, ki ga nameravate izboljšati in izboljšati napovedi kot nove dokazne površine. Zanimiva dejavnost je prilagajanje dejavnikov tako, da razpoznavne teoretične lastnosti prenese na P (B) ali P (A) in upošteva njihov skladen učinek na P (A | B). Na primer, če povečate imenovalec P (B) na desni, se na tej točki P (A | B) spusti. Trden model: izcedek iz nosu je pokazatelj ošpic, vendar so izcedek iz nosu nedvomno bolj značilni kot kožni izpuščaji z majhnimi belimi pikami. To pomeni, da v primeru, da izberete P (B), kjer je B izcedek iz nosu, takrat ponovitev izpuščaja izpuščaja v splošni javnosti zavrne možnost, da je izcedek iz nosu znak ošpic. Verjetnost ugotovitve ošpic se zmanjšuje glede na stranske učinke, ki postajajo postopoma normalni; te manifestacije niso trdni kazalci. Podobno, ko ošpice postajajo vedno bolj normalne in P (A) naraste v števcu na desni strani, P (A | B) v bistvu naraste, ker so ošpice navadno bolj verjetno, če malo pozornosti namenimo stranskemu učinku, meniš.

Uporaba Bayesovega teorema v strojnem učenju

Naive Bayesov klasifikator

Naive Bayes je izračun karakterizacije za vprašanja dvojnega (dvorazrednega) in večvrstnega združevanja. Sistem je najmanj zahteven za razumevanje, če je prikazan z uporabo dvojnih ali naravnih informacijskih lastnosti.

Imenujemo ga naivni Bayes ali imbecilen Bayes glede na to, da je določanje verjetnosti za vsako teorijo racionalizirano, da bi bilo njihovo štetje mogoče slediti. V nasprotju s prizadevanji za ugotavljanje ocen vsake lastnosti P (d1, d2, d3 | h) se šteje, da so glede na vrednost cilja omejena in so določeni kot P (d1 | h) * P (d2 | H, itd.

To je trdna domneva, ki je na primer najbolj pristna v resničnih informacijah, da lastnosti ne komunicirajo. Metodologija že na koncu deluje šokantno dobro glede informacij, kjer ta domneva ne drži.

Portrajal, ki ga uporabljajo modeli Naive Bayes

Verjetnost je upodobitev naivnega Bayesovega algoritma.

Zbirke z verjetnostmi so podvržene prošnji za znanstveno naivni Bayesov model. To vključuje:

Verjetnost razreda: Verjetnost za vse v naboru podatkov o pripravah.

Pogojna verjetnost: Pogojna verjetnost za informacije o vsakem primerku, ki jih je treba upoštevati za vsak razred.

Vzemite v Naive Bayes model iz podatkov. Naivni Bayesov model iz informacij o pripravi je hiter. Priprava je hitra glede na to, da je treba določiti osamljene verjetnostne vrednosti za vsak primerek razreda in vrednost verjetnosti za vsak primerek razreda z različnimi vrednostmi informacij (x). Sistemom izboljšav ne bi smel ustrezati noben koeficient.

Število verjetnosti razreda

Verjetnost razreda je v bistvu ponovitev primerov, pri katerih je vsak razred ločen od celotnega števila primerov.

Na primer, v vzporednem razredu je verjetnost primera, ki ima mesto z razredom 1, določena kot:

Verjetnost (razred = 1) = skupno (razred = 1) / (skupaj (razred = 0) + skupaj (razred = 1))

V najbolj preprostem primeru je vsak razred, ki ima verjetnost 0, 5 ali polovico za dvojno razvrstitev s podobnim številom pojavitev v vseh instancah razreda.

Slika pogojne verjetnosti

Pogojne verjetnosti so ponovitev vsake ocene lastnosti za določen razred, ki jo je vredno deliti ponovitev primerov s tem spoštovanjem razreda.

Vse aplikacije Bayesovega teorema

Bayesova teorema je v resnici veliko uporabna. Ne izpostavljajte možnosti, da ne vidite takoj vse aritmetike. Za začetek je preprosto dobiti občutek, kako deluje.

Bayesova teorija odločitev je merljiv način za reševanje vprašanja zgledne klasifikacije. V skladu s to hipotezo je pričakovati, da je osnovni prenos verjetnosti za razrede znan. Na ta način pridobimo popoln Bayesov klasifikator, proti katerem se vsak drugi klasifikator odloči za izvedbo.

Govorili bomo o treh temeljnih uporabih Bayesove teoreme:

- Naive Bayesov klasifikator

- Diskriminatorne funkcije in površine odločanja

- Ocena Bayesovega parametra

Zaključek

Veličastnost in intenzivnost Bayesove teoreme me nikoli ne ustavijo. Osnovna ideja, ki jo je dal duhovnik, ki je prenesel več kot 250 let nazaj, je danes uporabljen v absolutno najbolj nezmotljivih postopkih AI.

Priporočeni članki

To je vodnik po Bayesovi teoremi. Tukaj razpravljamo o uporabi Bayesove teoreme pri strojnem učenju in portretiranju, ki ga uporabljajo primeri naivnih Bayesov s primeri. Za več informacij si lahko ogledate tudi naslednje članke -

- Naivni Bayesov algoritem

- Vrste algoritmov strojnega učenja

- Modeli strojnega učenja

- Metode strojnega učenja