Pregled linearnega regresijskega modeliranja

Ko se začnete učiti o algoritmih strojnega učenja, začnete spoznavati različne načine algoritmov ML, tj. Nadzorovano, nenadzorovano, polovično nadzorovano in okrepljeno učenje. V tem članku bomo obravnavali nadzorovano učenje in enega osnovnih, vendar močnih algoritmov: Linearna regresija.

Torej, nadzorovano učenje je učenje, pri katerem usposobimo stroj, da razume razmerje med vhodnimi in izhodnimi vrednostmi, določenimi v naboru podatkov o vadbi, nato pa uporabimo isti model za napoved izhodnih vrednosti za nabor podatkov za testiranje. Torej, če imamo izhod ali označevanje že na voljo v našem naboru podatkov o vadbi in smo prepričani, da zagotovljeni izhod smiselno ustreza vhodu, potem uporabimo nadzorovano učenje. Nadzorovani učni algoritmi so razvrščeni v regresijo in klasifikacijo.

Regresijski algoritmi se uporabljajo, ko opazite, da je izhod neprekinjena spremenljivka, medtem ko se algoritmi za razvrščanje uporabljajo, ko je izhod razdeljen na odseke, kot so Pass / Fail, Good / Average / Bad itd. Imamo različne algoritme za izvajanje regresije ali klasifikacije dejanja z linearnim regresijskim algoritmom kot osnovnim algoritmom v regresiji.

Preden grem v algoritem, naj vam postavim podlago. V šolanju upam, da se spomnite koncepta enačbe črt. Naj povem nekaj o tem. Dobili ste dve točki na ravnini XY, torej recimo (x1, y1) in (x2, y2), kjer je y1 izhod x1 in y2 izhod x2, potem je enačba premice, ki poteka skozi točke, (y- y1) = m (x-x1), kjer je m naklon premice. Zdaj, ko najdete enačbo premice, če vam je dano točko reči (x3, y3), bi zlahka lahko predvideli, če točka leži na premici ali oddaljenost točke od premice. To je bila osnovna regresija, ki sem jo naredil v šolanju, ne da bi se sploh zavedal, da bi to imelo tako velik pomen pri strojnem učenju. Kar na splošno počnemo pri tem, je, da poskusimo prepoznati enačbno črto ali krivuljo, ki bi lahko ustrezala vhodu in izhodu niza podatkov vlaka, nato pa uporabite isto enačbo za napoved izhodne vrednosti preskusnega niza. To bi imelo za posledico stalno želeno vrednost.

Opredelitev linearne regresije

Linearna regresija obstaja že zelo dolgo (približno 200 let). To je linearni model, tj. Predvideva linearno razmerje med vhodnimi spremenljivkami (x) in eno samo izhodno spremenljivko (y). Y tukaj se izračuna na podlagi linearne kombinacije vhodnih spremenljivk.

Imamo dve vrsti linearne regresije

Preprosta linearna regresija

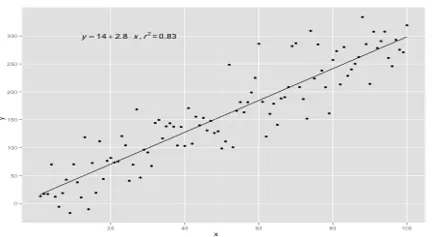

Če obstaja ena vhodna spremenljivka, tj. Enačba vrstice je c

štejemo kot y = mx + c, potem je preprosta linearna regresija.

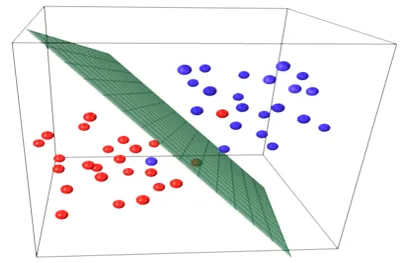

Večplastna regresija

Kadar obstaja več vhodnih spremenljivk, tj. Enačba premice se šteje kot y = ax 1 + bx 2 +… nx n, potem je to večkratna linearna regresija. Za pripravo ali urjenje regresijske enačbe iz podatkov se uporabljajo različne tehnike, najpogostejša med njimi pa se imenuje Navadni najmanjši kvadratki. Model, zgrajen po omenjeni metodi, se imenuje navadna regresija najmanjših kvadratov ali zgolj regresija z najmanjšimi kvadratki. Model se uporablja, kadar so vhodne vrednosti in izhodne vrednosti, ki jih je treba določiti, numerične. Kadar sta samo en vhod in en izhod, potem je sestavljena enačba vrstica enačba t.i.

y = B0x+B1

kjer se koeficienti premice določijo s statističnimi metodami.

Enostavni modeli linearne regresije so pri ML zelo redki, saj bomo na splošno imeli različne vhodne dejavnike, da bomo lahko določili rezultat. Kadar je več vhodnih vrednosti in ene izhodne vrednosti, potem je sestavljena enačba ravnine ali hiperravnine.

y = ax 1 +bx 2 +…nx n

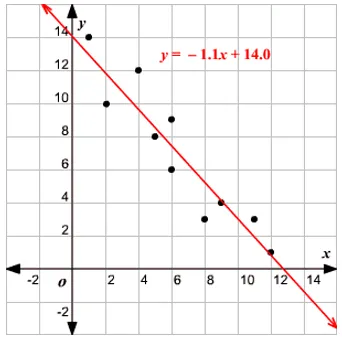

Osnovna ideja regresijskega modela je pridobiti enačbo črt, ki najbolje ustreza podatkom. Najbolj primerna vrstica je tista, pri kateri je celotna napaka napovedovanja za vse podatkovne točke, ki se štejejo za čim manjše. Napaka je razdalja med točko na ravnini in regresijsko črto.

Primer

Začnimo s primerom Enostavne linearne regresije.

Razmerje med višino in težo osebe je neposredno sorazmerno. Na prostovoljcih je bila izvedena študija, s katero so ugotovili višino in idealno težo osebe, vrednosti pa so bile zabeležene. To bo veljalo za naš nabor podatkov o usposabljanju. Z uporabo podatkov vadbe se izračuna enačba regresijske črte, ki bo dala minimalno napako. Ta linearna enačba se nato uporablja za napovedovanje novih podatkov. To pomeni, če damo višino osebe, potem je treba ustrezno težo napovedati po modelu, ki smo ga razvili z minimalno ali nič napako.

Y(pred) = b0 + b1*x

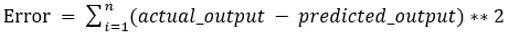

Vrednosti b0 in b1 morata biti izbrani tako, da zmanjšata napako. Če za oceno modela vzamemo vsoto kvadratne napake kot metriko, potem je cilj pridobiti črto, ki najbolje zmanjša napako.

Napako razvrščamo, tako da se pozitivne in negativne vrednosti med seboj ne bodo odpovedale. Za model z enim napovedovalcem:

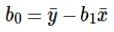

Izračun prestrezka (b0) v enačbi premice opravi:

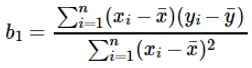

Izračun koeficienta za vhodno vrednost x opravi:

Razumevanje koeficienta b 1 :

- Če je b 1 > 0, sta x (vhod) in y (izhod) sorazmerna. To pomeni, da se bo povečanje x povečalo y, kot je povečanje višine, povečanje teže.

- Če je b 1 <0, sta x (prediktor) in y (cilj) obratno sorazmerna. To pomeni, da se bo povečanje x zmanjšalo y, na primer hitrost vozila se poveča, čas se zmanjša.

Razumevanje koeficienta b 0 :

- B 0 prevzame preostalo vrednost za model in zagotavlja, da napoved ni pristranska. Če nimamo izraza B 0, je enačba premice (y = B 1 x) prisiljena skozi izvor, tj. Vhodne in izhodne vrednosti, vnesene v model, rezultirajo v 0. Toda to ne bo nikoli, če imamo 0 v vnosu, potem je B 0 povprečje vseh predvidenih vrednosti, ko je x = 0. Če postavite vse vrednosti napovednika na 0 v primeru x = 0, bo to povzročilo izgubo podatkov in je pogosto nemogoče.

Poleg zgoraj omenjenih koeficientov lahko ta model izračunamo tudi z običajnimi enačbami. Nadalje bom razpravljala o uporabi običajnih enačb in oblikovanju preprostega / večlinearnega regresijskega modela v svojem prihodnjem članku.

Priporočeni članki

To je vodnik za linearno regresijsko modeliranje. Tukaj razpravljamo o definiciji, tipih linearne regresije, ki vključuje preprosto in več linearno regresijo ter nekaj primerov. Če želite izvedeti več, si oglejte tudi naslednje članke -

- Linearna regresija v R

- Linearna regresija v Excelu

- Predvidevno modeliranje

- Kako ustvariti GLM v R?

- Primerjava linearne regresije in logistične regresije