Uvod v metode strojnega učenja

Naslednji članek Metode strojnega učenja ponuja oris najpogosteje uporabljenih metod v strojnem učenju. Strojno učenje je tehnika, ki računalniku omogoča, da se stvari 'nauči' sam. Algoritmi prilagodljivo izboljšujejo svojo uspešnost, saj se podatki, ki so na voljo za učenje, povečujejo. To je več podatkov, bolj natančen bi bil naš model.

Kako se stroji učijo?

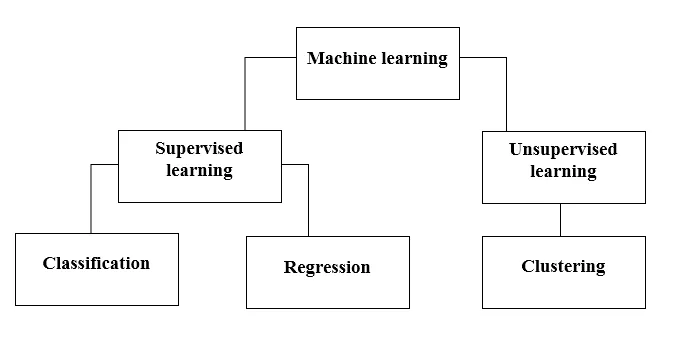

Obstajajo različne metode za to. Kateri način v celoti uporabiti, je odvisno od navedbe problema. Glede na nabor podatkov in našo težavo obstajata dva različna načina, da se poglobite. Eno je nadzorovano učenje, drugo pa nenadzorovano učenje. Naslednji grafikon razlaga nadaljnjo klasifikacijo metod strojnega učenja. O njih bomo razpravljali drug za drugim.

Oglejte si naslednji grafikon!

Razumejmo, kaj pomeni nadzorovano učenje.

Nadzorovano učenje

Kot že ime pove, si predstavljajte učitelja ali nadzornika, ki vam bo pomagal pri učenju. Enako velja za stroje. Stroj treniramo ali učimo z uporabo podatkov, ki so označeni.

Nekatere najbolj kul aplikacije za učenje pod nadzorom so:

- Analiza občutka (Twitter, Facebook, Netflix, YouTube itd.)

- Obdelava naravnega jezika

- Razvrstitev slik

- Napovedna analiza

- Prepoznavanje vzorcev

- Odkrivanje neželene pošte

- Govor / zaporedje obdelave

Zdaj je nadzorovano učenje nadalje razdeljeno na klasifikacijo in regresijo. Razumejmo to.

Razvrstitev

Klasifikacija je postopek iskanja modela, ki pomaga ločevati podatke v različne kategorične razrede. V tem postopku se podatki razvrstijo pod različne nalepke glede na nekatere parametre, podane v vnosu, nato pa se nalepke predvidijo za podatke. Kategorično pomeni, da je izhodna spremenljivka kategorija, tj. Rdeča ali črna, nezaželena ali neželena, diabetična ali nediabetična itd.

Modeli razvrščanja vključujejo podporni vektorski stroj (SVM), K-najbližjega soseda (KNN), Naive Bayes itd.

a) Podporni vektorski klasifikator (SVM)

SVM je nadzorovana učna metoda, ki podatke pregleda in jih razvrsti v eno od dveh kategorij. Za kategorizacijo podatkov uporabljam hiperplane. Linearni diskriminatorni klasifikator poskuša narisati ravno črto, ki ločuje oba niza podatkov in s tem ustvari model za razvrstitev. Preprosto skuša najti črto ali krivuljo (v dveh dimenzijah) ali razdelilnik (v več dimenzijah), ki ločuje razrede drug od drugega.

Opomba - za razvrstitev v več razredov SVM uporablja 'ena proti počitku', kar pomeni izračunavanje različnih SVM za vsak razred.

b) K-najbližji klasifikator soseda (KNN)

- Če natančno preberete, že samo ime pove, kaj algoritem počne. KNN meni, da so podatkovne točke, ki so bližje, po značilnostih veliko bolj podobne in zato bolj verjetno pripadajo istemu razredu kot sosed. Za vsako novo podatkovno točko se izračuna razdalja do vseh drugih podatkovnih točk in razred se določi na podlagi K najbližjih sosedov. Da, morda se sliši hromo, a za nekatere klasifikacije deluje kot karkoli.

- Podatkovna točka je razvrščena po največjem številu glasov svojih sosedov, nato pa je podatkovna točka dodeljena najbližjemu razredu med k sosedi.

- V KNN ni potrebno učenje modela in vse delo se zgodi v času, ko se zahteva napoved. Zato KNN pogosto imenujejo algoritem lenega učenja.

c) Naiven Bayesov klasifikator

- Naive Bayes je algoritem strojnega učenja, ki je zelo priporočljiv za težave s klasifikacijo besedila. Temelji na Bayesovem verjetnostnem teoremu. Te klasifikatorje imenujemo naivne, ker domnevajo, da so spremenljivke funkcij med seboj neodvisne. To pomeni, da imamo na primer celoten stavek za vnos, potem Naive Bayes predpostavlja, da je vsaka beseda v stavku neodvisna od drugih. In potem jih ustrezno razvrstite. Vem, izgleda precej naivno, vendar je odlična izbira za težave z razvrščanjem besedila in priljubljena izbira za klasifikacijo neželene pošte.

- Ponuja različne vrste algoritmov Naive Bayes, kot so BernoulliNB, GaussianNB, MultinomialNB.

- Vse funkcije menijo, da niso povezane, zato se ne more naučiti razmerja med funkcijami. Recimo, da Varun rad jesti burgerje, rad je jedel tudi krompirček s koksom. Vendar ne mara jesti burgerja in kombinacije krompirčka s koksom. Tu se Naive Bayes ne more naučiti razmerja med dvema lastnostma, ampak se samo nauči samo pomembnosti posameznika.

Zdaj pa preidimo na drugo stran našega nadzorovanega načina učenja, ki je regresija.

Regresija

Regresija je postopek iskanja modela, ki pomaga razlikovati podatke z uporabo kontinuiranih vrednosti. Pri tem je urejena narava predvidenih podatkov. Nekateri najpogosteje uporabljeni regresijski modeli vključujejo linearno regresijo, naključni gozd (drevesa odločitve), nevronske mreže.

Linearna regresija

- Eden najpreprostejših pristopov pri nadzorovanem učenju, ki je uporaben pri napovedovanju količinskega odziva.

- Linearna regresija vključuje iskanje najprimernejše ravne črte skozi točke. Najbolj prilegajoča se linija imenuje regresijska linija. Najprimernejša črta ne gre natančno skozi vse podatkovne točke, ampak se namesto njih poskuša najbolje približati.

- To je široko uporabljen algoritem za neprekinjene podatke. Vendar se osredotoča le na srednjo vrednost odvisne spremenljivke in se omeji na linearni odnos.

- Linearna regresija se lahko uporablja za časovne serije, napovedovanje trendov. Na podlagi predhodnih podatkov lahko napoveduje prihodnjo prodajo.

Nenadzorovano učenje

- Nenadzorovano učenje temelji na pristopu, ki ga lahko razumemo kot odsotnost učitelja in zato absolutne ukrepe napak. Uporabno je, kadar se je treba naučiti združevanja ali razvrščanja elementov. Elemente lahko razvrstimo (zgrudijo) glede na podobnost.

- Pri nenadzorovanem učenju podatki niso označeni, ne kategorizirani in algoritmi sistema delujejo na podatke brez predhodnega usposabljanja. Nenadzorovani učni algoritmi lahko opravljajo bolj zapletene naloge od nadzorovanih učnih algoritmov.

- Nenadzorovano učenje vključuje gručenje, ki ga je mogoče izvesti s pomočjo K pomeni grozdenje, hierarhično, Gaussovo mešanico, skriti Markov model.

Nenadzorovane aplikacije za učenje so:

- Zaznavanje podobnosti

- Samodejno označevanje

- Segmentacija predmeta (kot so osebe, živali, filmi)

Grozd

- Grozdanje je nenadzorovana učna tehnika, ki se uporablja za analizo podatkov na številnih področjih. Algoritem združevanja je koristen, ko želimo pridobiti podrobne vpoglede v naše podatke.

- Pravi primer grozdanja so Netflixovi žanrski grozdi, ki so razdeljeni na različne ciljne stranke, vključno z interesi, demografijo, življenjskim slogom itd. Zdaj si lahko omislite, kako koristno je grozdenje, ko podjetja želijo razumeti svojo stranko in ciljajo na nov potencial kupci.

a) K pomeni grozd

- K pomeni algoritem združevanja poskuša razdeliti dane neznane podatke v grozde. Naključno izbere 'k' centroide grozdov, izračuna razdaljo med podatkovnimi točkami in centroidi grozdov in nato končno dodeli podatkovno točko centroidu grozda, katerega razdalja je najmanjša od vseh centroidov grozda.

- V k-pomenih skupine za vsako skupino določi najbližji centroid. Ta centroid deluje kot "možgani" algoritma, pridobijo podatkovne točke, ki so jim najbližje, in jih nato dodajo v grozde.

b) Hierarhična gruča

Hierarhično združevanje je skoraj podobno kot pri običajnem združevanju, razen če želite sestaviti hierarhijo grozdov. To je lahko koristno, če želite določiti število gruč. Recimo, da v spletni trgovini z živili ustvarjate skupine različnih predmetov. Na sprednji domači strani želite nekaj širokih elementov in ko kliknete na enega od elementov, se odprejo določene kategorije, to je bolj posebne skupine.

Zmanjšanje dimenzij

Zmanjšanje dimenzij se lahko šteje za stiskanje datoteke. Pomeni, da vzamete informacije, ki niso pomembne. Zmanjšuje zapletenost podatkov in poskuša obdržati smiselne podatke. S stiskanjem slike na primer zmanjšamo dimenzionalnost prostora, v katerem slika ostane takšna, kot je, ne da bi uničili preveč smiselne vsebine na sliki.

PCA za vizualizacijo podatkov

Analiza glavnih komponent (PCA) je metoda zmanjšanja dimenzij, ki je lahko koristna za vizualizacijo vaših podatkov. PCA se uporablja za stiskanje podatkov višjih dimenzij na podatke z nižjimi dimenzijami, torej lahko s PCA zmanjšamo štiridimenzionalne podatke v tri ali dve dimenziji, da lahko vizualiziramo in bolje razumemo podatke.

Priporočeni članki

To je vodnik za metode strojnega učenja. Tu smo razpravljali o uvodu, kako se stroji učijo? klasifikacij strojnega učenja in diagrama poteka skupaj s podrobno razlago. Če želite izvedeti več, lahko preberete tudi druge naše predlagane članke -

- Arhitektura strojnega učenja

- Okviri strojnega učenja

- Orodja za strojno učenje

- Tehnike strojnega učenja

- Strojno učenje hiperparametrov

- Hierarhični algoritem grozda

- Hierarhična gruča | Aglomerativno in delitveno grozdenje